Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Існують такі типи топології локальних мереж: зірка, кі- льце, шина, дерево, комбінована. 2 page

|

|

5.1  Загальні поняття про інформацію

Загальні поняття про інформацію

Будь-яке управління випливає з інформації для вибору ке- рівних впливів, а самі управляючі впливи формуються на основі інформації, яка міститься у командах управління. Відомо, що одним із перших та найважливіших завдань управління є регу- лювання стану об'єктів управління. Регулювання вимагає послі- довності виконання операцій, основні із яких:

Ø одержання відомостей про стан об'єкту управління або процесу;

Ø одержання ззовні командних впливів, які визначають по- трібний стан об'єкта, або процесу;

Ø обробка одержаних сигналів з метою найбільш ефектив- ного приведення об'єкту у відповідність до завдання;

Ø формування управляючих впливів, які за допомогою ви- конуючих органів змінюють режим роботи об'єкта.

Інформація не супроводжує процеси управління, а, навпа- ки, створює умови, за яких вони можуть здійснюватися. У будь- якому процесі управління інформація грає основну роль.

На даний час немає єдиного взаємоузгодженого визначен- ня поняття інформації, але найбільш поширеними є таке:

На даний час немає єдиного взаємоузгодженого визначен- ня поняття інформації, але найбільш поширеними є таке:

Інформація – це сукупність відомостей, які визначають міру наших знань про ті або інші події, явища і факти.

Важливу роль відіграє інформація у всебічному житті сус- пільства. Але є очевидними і труднощі, пов'язані із необхідністю використовувати великі потоки інформації так, щоб своєчасно та оперативно одержувати ту інформацію, яка необхідна для ро- зв'язку даного завдання, швидкого прийняття потрібного в да- ний момент рішення.

До основних видів інформації належать:

Ø технологічна, яка представляє собою потік фізичних параметрів – напруги, струму, частоти, швидкості руху і т.п., які характеризують перетворення сировини в го- тову продукцію;

Ø економічна, у вигляді сукупності числових показників, таблиць, нормативів і т.п.;

Ø наукова інформація – складається, як правило, з рефе- ратів, книг, звітів, патентів, журнальних статей і т.п.;

Ø соціальна, культурна, медична, спортивна і т.д

Але якого б виду не була інформація, для можливості її обробки в електронно-обчислювальній машині (ЕОМ), вона по- винна бути закодована (переведена) в дискретну (цифрову) фо- рму і у вигляді даних (тобто набору цифр) подана в інформацій- ну систему. При цьому, якщо інформація аналогова, тобто без- перервна (наприклад, напруга постійного струму, яка зміню- ється у часі), то її необхідно попередньо дискретизувати, тобто замінити ступінчатою функцією, яка має постійні значення на відрізках A(t) часу, які називаються кроком дискретизації (так- тами). Значення функції на окремих тактах можуть бути закодо- вані в цифровій формі.

5.2  Схема збору, обробки та передачі інформації

Схема збору, обробки та передачі інформації

У загальній схемі системи збору і передачі інформації має місце перетворення типу: повідомлення – сигнал – дані – інфор- мація (рис. 2.1).

Вхідне повідомлення з допомогою первинного інформа- ційного перетворювача (ПІП) перетворюється найчастіше в еле- ктричний сигнал, який є найбільш зручним для передачі й обро- бки. Інформація в приймачі формується в текстовому або в гра- фічному вигляді, зручному для сприйняття людиною. Для цього служить спеціальний інформаційний пристрій декодування (ПДК) сигналів. Канал зв'язку в загальному випадку не тільки передає сигнали, але й перетворює їх.

Джерелом інформації може бути положення вказівника на авто- маті захисту, горіння сигнальної лампи і т.д. Повідомленням на- зиваються відомості про стан джерела. Для передачі повідом- лень використовують сигнали, які по наявних каналах надходять до приймача повідомлень.

Необхідно розрізняти поняття "інформація " і "повідом- лення ".

Необхідно розрізняти поняття "інформація " і "повідом- лення ".

Під повідомленням розуміють інформацію, яка виражена у певній формі, що піддається передачі.

Повідомлення – це форма подання інформації.

Повідомлення – це форма подання інформації.

Прикладами повідомлень є тексти телеграми, мова оратора, покази вимірювального пристрою, команди управління, зобра- ження на екрані телевізора і т.п.

Прикладами повідомлень є тексти телеграми, мова оратора, покази вимірювального пристрою, команди управління, зобра- ження на екрані телевізора і т.п.

Сигналом називають фізичний процес, який однозначно відображає повідомлення, яке передається із заданою точністю та придатне для його обробки і передачі на відстань.

|

Джерело Повідомлення

Джерело Повідомлення

ПІП

Приймач

Приймач

Дані

ПДК

Інформація Людина

Рисунок 2.1

Процес перетворення повідомлень у дискретний сигнал на- зивають кодуванням інформації.

Процес перетворення повідомлень у дискретний сигнал на- зивають кодуванням інформації.

Множину різних кодових комбінацій, які одержуються при даному варіанті кодування, – кодом. Зворотнє перетворення си- гналу в повідомлення називають декодуванням.

Подана схема відповідає основним принципам обробки ін- формації в електронно-обчислювальній машині (ЕОМ). Важли- вою перевагою систем цифрової обробки сигналів на базі ЕОМ є можливість виділення дуже слабкого сигналу, який має значно меншу величину, ніж присутній шум. Так використовуючи ха- рактерні особливості частотного спектру сигналу, який надхо- дить від об'єкту, виділяється інформація про наявність такого об'єкта в деякій області, про його просторове розміщення, стан і напрямок руху (зміни). В системі цифрової обробки сигналів сигнал відразу перетворюється в цифрову форму, що виключає додаткові похибки і спотворення. В подальшому вся обробка сигналу виконується в цифровій формі в ЕОМ.

Інформація може мати кількісні і якісні характеристики. Будь-яку інформацію можна одержати тільки після прийняття повідомлення, тобто внаслідок проведення досліду. Повідом- лення, яке формується в приймачі, несе корисну інформацію лише у тому випадку, якщо є невизначеність відносно стану джерела повідомлень.

Якщо дослід може мати тільки один результат і немає ні- якої невизначеності, то можна наперед знати цей результат. То- му в такому випадку у вихідному повідомленні не буде інфор- мації.

У випадку, коли дослід може мати два однаково ймовірних результати, наприклад, якщо контрольований параметр знахо- диться в межах норми або за її межами, повідомлення, яке буде передаватися, буде набувати два значення і вже міститиме певну інформацію.

Крім кількісної міри інформація, яка використовується при розв'язку завдань управління, характеризується і якісними пока- зниками. Одним із таких показників є тип даних, який визначає

характер змісту інформації, яка нагромаджується і перетворю- ється системами управління.

Існують такі типи даних

Ø аналогові;

Ø цифрові;

Ø символьні

Цифрові дані, які формуються внаслідок вимірювань, від- носять до типу дійсних даних. Різні змінні, які визначають кіль- кість предметів, людей, циклів обробки є цілочисельними дани- ми. Значне місце у пам'яті ЕОМ займають символьні дані, за до- помогою яких формуються різні повідомлення і вказівки. Спеці- альні оголошення типу даних у програмах визначають спосіб обробки і форму зберігання значень даних в пам'яті ЕОМ. Це необхідно, тому що будь-які букви, математичні знаки, цифри, інструкції і тексти зображаються в пам'яті ЕОМ в цифровій фо- рмі.

Дані – це інформація, яка використовується в процесі роз- в'язку різних задач на ЕОМ.

Дані – це інформація, яка використовується в процесі роз- в'язку різних задач на ЕОМ.

На практиці часто використовують слово "дані", як сино- нім до інформації, однак між ними є суттєва різниця. Дані – це величини, їх відношення, словосполучення, факти, перетворення і обробка яких дозволяє одержати інформацію, тобто знання про той або інший предмет, процес чи явище. Іншими словами, дані використовуються, як сировина для створення інформації, оде- ржаної внаслідок обробки даних. Коли дані є структурованими, тоді ми отримуємо інформацію, а коли інформація підготовлена до використання тоді ми маємо знання.

Знання повинні завжди бути доступні для використання. Тому наш світ швидкими темпами стає цифровим і це допомагає ефективно керувати величезними потоками інформації і викори- стовувати її колективно.

Розв'язок довільної задачі, математичної чи логічної, зав- жди пов'язаний з перетворенням інформації, тобто перетворен- ням вихідних даних в шукані результати. Як правило, вихідні дані і результати виражаються різними символами, але в одна- ковому алфавіті. Можливе також і посимвольне перетворення

інформації з одного алфавіту в інший. Наприклад, використо- вуючи два символи - нуль і одиницю, можна перетворити цифри десяткової системи числення, що складається з алфавіту і десяти символів: 0,1,2,3,4,5,6,7,8,9, в двобуквенне зображення (в циф- рах двійкової системи числення), тобто представити їх двійко- вим алфавітом відповідно 0,1,10,11,100,101,110,111,1000,1001. Таким чином, однакові абсолютні значення цифр можуть бути представлені в декількох різних системах шляхом зміни їх коду- вання.

При передачі та обробці інформації за допомогою ЕОМ необхідно розрізняти основні одиниці представлення даних: си- мвол, розряд, слово, рядок, запис, файл, пакет.

При передачі та обробці інформації за допомогою ЕОМ необхідно розрізняти основні одиниці представлення даних: си- мвол, розряд, слово, рядок, запис, файл, пакет.

Символ – це буква, десяткова цифра, чи який-небудь ін- ший знак.

В десятковому, шістнадцятковоому, буквенному зобра- женні символ займає один розряд. При кодуванні в двійковому зображенні байт займає декілька розрядів, що супроводжується впорядкованим поєднанням бітів. Ці поєднання відповідають коду, прийнятому для даного символу.

В десятковому, шістнадцятковоому, буквенному зобра- женні символ займає один розряд. При кодуванні в двійковому зображенні байт займає декілька розрядів, що супроводжується впорядкованим поєднанням бітів. Ці поєднання відповідають коду, прийнятому для даного символу.

Розряд – місце розміщення символу інформації в машин- ному слові.

Порядковий відрахунок розрядів починається з молодшо- го і йде справа наліво. Крайній правий розряд – молодший роз- ряд, крайній лівий – найстарший розряд. У двійковому зобра- женні в розряді розміщується найменша одиниця інформації – біт (0 чи 1), яка в машині відображається одним станом переми- каючого елемента.

Порядковий відрахунок розрядів починається з молодшо- го і йде справа наліво. Крайній правий розряд – молодший роз- ряд, крайній лівий – найстарший розряд. У двійковому зобра- женні в розряді розміщується найменша одиниця інформації – біт (0 чи 1), яка в машині відображається одним станом переми- каючого елемента.

Слово – це представлення інформації в числовій формі.

При буквенній і знаковій інформації - це один або декілька символів, згрупованих для машинного представлення (звичайно, в двійковій системі числення). Кількість двійкових розрядів, що використовуються для цих цілей, є довжина слова, яка може бу- ти фіксованою – з постійною (для машини) кількістю розрядів, що використовуються.

Рядок – кількість символів, що обробляються та відобра- жають інформацію за змістом чи приналежністю.

Рядок – кількість символів, що обробляються та відобра- жають інформацію за змістом чи приналежністю.

Запис – сукупність декількох слів змінної довжини, орга- нічно зв'язаних між собою, тобто декількох рядків, що утворю- ють єдине ціле.

Запис – сукупність декількох слів змінної довжини, орга- нічно зв'язаних між собою, тобто декількох рядків, що утворю- ють єдине ціле.

Файл – група записів, що мають однакову структуру та ві- дносяться да однойменних об'єктів, які об'єднують інформаційні масиви.

Файл – група записів, що мають однакову структуру та ві- дносяться да однойменних об'єктів, які об'єднують інформаційні масиви.

Тобто файл – це група записів однакового типу для даної роботи і при даному розрахунку.

Тобто файл – це група записів однакового типу для даної роботи і при даному розрахунку.

Пакет – базова одиниця даних у мережі Internet.

Повідомлення, що пересилається по мережі, розбивається на пакети, кожний із яких постачається адресою й іншою необ- хідною інформацією (зокрема, кодами перевірки на наявність помилок). Протоколи TCP/IP забезпечують належне складання пакетів у місці одержання.

5.3  Оцінка кількості інформації

Оцінка кількості інформації

5.3.1  Логарифмічна міра оцінки інформації

Логарифмічна міра оцінки інформації

У будь-якому процесі управління інформація відіграє ос- новну роль. Це тим більше помітно, чим складніший процес, і тим більше різних можливостей виникає перед системою, чим серед більшої кількості можливостей здійснюється вибір у про- цесі управління. Для того, щоб описувати інформаційні процеси і передбачати наслідки їх, за умови знання причин, необхідно зробити інформацію вимірюваною величиною. Тобто потрібно ввести одиницю вимірювання і запропонувати метод вимірю- вання кількості інформації.

Комбінаторна міра кількості інформації оцінюється по кі- лькості можливих комбінацій інформаційних елементів (зна-

чень, рівнів сигналів і т.д.). Для розглянутого прикладу дорів- нює

Q=(Tmax-Tmin)/AT+1, (2.1)

де Тmах і Тmіn – відповідно максимальне і мінімальне виміряне значення величини на достатньо великому інтервалі спостере- ження. Чим вища точність приладу і менше квант AT, тим біль- ша кількість комбінацій, а відповідно і інформації в кожному вимірюванні.

Мінімальна кількість інформації одержується в досліді, в якому можна визначити всього два можливих виходи: «так» або

«ні», «біле» або «чорне», «включено» або «виключено».

В інформатиці та обчислювальній техніці кількість інфор- мації, яка міститься у визначенні одного із двох можливих вихі- дних результатів досліду, називається бітом.

В інформатиці та обчислювальній техніці кількість інфор- мації, яка міститься у визначенні одного із двох можливих вихі- дних результатів досліду, називається бітом.

Біт (англ. bit - маленький шматочок) – це основна одиниця для вимірювання інформації.

Біт може приймати два значеня: 0 або 1. Цифри «1» та «0» є символами найпростішої знакової системи – бінарної системи обліку. В кожній цифрі (знаку) бінарного числа міститься 1 біт інформації.

Відомо, що результати вимірювань однорідних фізичних величин додаються, якщо самі величини додаються одна до од- ної. Ця властивість називається адитивністю. Щоб задовільнити вимогу адитивності міри кількості інформації, Р.Хартлі запро- понував виміряти кількість інформації бінарною логарифмічною мірою

І = log2Q, (2.2)

де Q – кількість різних комбінацій інформаційних елементів (рі- внів, сигналів, знаків і т.д.).

Формулу (2.2) можна виразити інакше: кількість інформа- ції дорівнює степеню, до якого необхідно піднести 2, щоб одер- жати число рівноправних варіантів вибору, тобто

2і = 16, дe i = 4 біти.

Для оцінки великих об'ємів інформації використовують похідні від біту одиниці:

Кілобіт = 210біт = 1024 біт (Кбіт);

Мегабіт = 210Кбіт = 220Кбіт = 1048576 біт (Мбіт).

Особливе значення для вимірювання об'ємів символьної інформації в обчислювальній техніці має спеціальна одиниця байт (англ. bite – виділений кусок, зчеплення) 1 байт = 8 біт, що відповідає 8-ми розрядам бінарного числа, які використовують- ся тільки разом, як код символів мови спілкування користувача з ЕОМ. Вимірювання інформації в байтах дає змогу зразу оцінити кількість символів у повідомленні. Об'єм пам'яті ЕОМ вимірю- ють у похідних від байта одиницях:

Кілобайт = 210байт = 1024 байт; Мегабайт = 210Кбайт = 220байт = 223біт.

За Р.Хартлі визначенні одиниці інформації біта як об'єму інформації, який потрібний при повній відсутності попередніх даних для вибору із двох рівноцінних і повністю незалежних ва- ріантів. Виміряти інформацію за Р.Хартлі – це значить перера- хувати кількість можливих реалізацій якогось стану, а потім взяти логарифм від цієї кількості. Межа величини інформації зумовлена квантовою природою процесів, які відбуваються у світі.

Таким чином інформація є:

1. Об'єктивною фізичною величиною, має кількісну оцінку і допускає точні вимірювання;

2. Використання міри Р.Хартлі не приводить до нескінчен- ної кількості інформації в силу квантування фізичних об'єктів і процесів, які породжують і переносять інфор- мацію. Наприклад, молекула в замкнутому об'ємі має обмежену кількість (множину) стаціонарних і таких, що відрізняються один від одного станів.

5.3.2  Ентропія як оцінка інформації

Ентропія як оцінка інформації

К.Шенон запропонував для оцінки кількості інформації ви- користовувати імовірнісну міру. Він використав відому в мате- матиці міру невизначеності, яка називається ентропією. Ентро- пія, як оцінка невизначеності відображає здатність матеріально- го джерела (об'єкта) проявляти нові стани і таким чином відда- вати інформацію.

Ентропія в теорії інформації кількісно визначається, як се- редня логарифмічна функція множини ймовірностей кожного із можливих результатів (виходів) досліду (ймовірностей можли- вих станів):

Qo

Qo

Но= - Pi

i 1

log 2 Pi

Qo

при Pi

при Pi

i 1

= 1, (2.3)

де Рі- імовірність деякого і-го повідомлення (і-го стану об'єкта); Но- загальна кількість і ентропія всіх можливих повідомлень (станів).

Незважаючи на свою недосконалість, запропоноване К.Шеноном визначення кількості інформації допомогло розв'я- зати багато практичних задач, наприклад, при виділенні сигналу на фоні шумів. Використовуючи методи К.Шенона, можна не тільки виявити, але і виправити окремі помилки, які зустріча- ються в текстах, що передаються, навіть у тих випадках, коли потужність шуму набагато перевищує потужність сигналу. Це дало сильний поштовх розвитку радіолокації, радіоастрономії та іншим галузях науки і техніки. Н.Вінер розглядав теорію інфор- мації К.Шенона, як складову частину кібернетики.

5.4  Інформаційні процеси

Інформаційні процеси

Найбільш поширеним способом одержання інформації є вимірювання – процес знаходження значення фізичної величини дослідним шляхом з допомогою спеціальних технічних засобів – інформаційних пристроїв (ІП). В ІП процес вимірювання вхідної і проміжних величин завершується, як правило, видачею інфор- мації, що вимірюється у формі, зручній для її подальшого вико- ристання.

При цьому інформацію, що вимірюється можна подати як сукупність повідомлень про значення величин, що вимірюються. Поряд з вимірюваннями, інформацію про властивості об'єктів можна отримати з допомогою контролю, лічби і діагностики.

При цьому інформацію, що вимірюється можна подати як сукупність повідомлень про значення величин, що вимірюються. Поряд з вимірюваннями, інформацію про властивості об'єктів можна отримати з допомогою контролю, лічби і діагностики.

Передача інформації – процес переміщення повідомлень від джерела до споживача з допомогою фізичного носія.

Повідомлення, які відображають одержану інформацію, можуть передаватися, як в цифровій, так і в аналоговій формі з використанням різних фізичних носіїв.

Каналами інформації в загальному випадку можуть бути як провідна лінія, так і вузли та блоки.

Каналами інформації в загальному випадку можуть бути як провідна лінія, так і вузли та блоки.

Перетворення інформації – процес впливу на параметри фізичного носія з метою зміни математичної або фізичної фор- ми подання інформації.

Перетворення повідомлень в електричні сигнали дає змогу здійснити наступне їх перетворення в цифрову форуму, що за- безпечує можливість для даних, одержаних від різних джерел стати швидко доступними в «машинозчитуваній» електронній формі, а потім вони можуть бути проаналізовані, скопійовані, збережені і передані.

Зберігання інформації в електронній формі має переваги, оскільки це дає змогу з мінімальними витратами поширювати інформацію серед багатьох її споживачів по цілому світу при допомозі мереж передачі даних, як локальних так і глобальних.

Обробка інформації – визначення математичних або ста- тичних її параметрів з потрібною точністю, швидкістю і досто- вірністю.

Обробка інформації – визначення математичних або ста- тичних її параметрів з потрібною точністю, швидкістю і досто- вірністю.

Основні види обробки інформації:

Ø обчислювальна, тобто виконання математичних операцій над вхідними величинами у відповідності із заданим алгоритмом;

Ø статистична, тобто визначення таких показ- ників, як дисперсія, статистичне сподівання, функ- ція кореляції, ентропія й ін;

Ø виділення корисної інформації, тобто виділення показників достовірності інформаційних процесів;

Ø адаптація, тобто оптимальне стиснення з метою під- вищення швидкості обробки без втрат точності і до- стовірності.

Операція – це довільна елементарна чи складна дія над ін- формацією, яка має певний зміст і направлена на її трансформа- цію (перетворення або передачу).

Інформаційна процедура – сукупність операцій одного ти-

пу.

Інформаційним потоком називається складений чи органі-

зований в межах інформаційної системи рух інформації в пев- них напрямках за той чи інший період часу і з певною метою.

зований в межах інформаційної системи рух інформації в пев- них напрямках за той чи інший період часу і з певною метою.

Розподіл інформації – це просторово-часова комутація блоків і вузлів, яка забезпечує реалізацію заданого алгоритму обробки потоків вхідної і проміжної інформації.

Використання інформації - вивід її на індикаторні, реєст- руючі та такі, що відображають інформацію, пристрої або на ви- конавчі органи.

Критерієм оцінки якості інформаційних процесів є коефіці- єнт втрат інформації, який характеризує три характерних скла- дові процесу інформатизації: інформаційне перевантаження, суттєві зміни в сфері передачі даних та інформаційний вибух. Велика кількість інформації, яка стає доступною внаслідок ви- користання засобів обчислювальної техніки і мережі передачі даних, дуже часто призводить до ситуації, коли користувач за-

знає великих перевантажень. Саме вони визначають ступінь споживання інформації користувачем.

5.5  Предстиавлення інформації у вигляді сигналів

Предстиавлення інформації у вигляді сигналів

У процесі пізнання виділяється певна обмежена кількість властивостей, спільних в якісному відношенні для ряду об'єктів, але індивідуальних для кожного з них у кількісному відношенні. Такі властивості носять назву фізичних величин. Фізичні вели- чини розрізняються в якісному і кількісному відношенні. Для знаходження фізичної величини дослідним шляхом з допомогою спеціальних технічних засобів використовують вимірювання.

Головні ознаки вимірювання:

а) виміряти можна властивості лише реально існуючих фізичних величин;

б) вимірювання включають проведення експеримента- льних дослідів (теоретичні розрахунки не можуть замі- нити експеримент);

в) для проведення експериментів потрібні спеціальні те- хнічні засоби, які взаємодіють з об'єктом вимірювання і називаються засобами вимірювання;

г) результатом вимірювання є значення фізичної вели- чини.

Фізичні величини діляться на неперервні (аналогові) і ква- нтовані (дискретні за розміром рівні).

Аналогова величина може мати в заданому діапазоні не- скінченну множину розмірів. У квантованої величини, напри- клад, малому електричному заряді, розмір визначається кількіс- тю зарядів електронів. Розміри квантованої величини визнача- ються рівнем квантування. Різницю двох сусідніх рівнів кванту- вання називають ступенем квантування (квантом).

Сигнал, функціонально зв'язаний з вимірюваною фізичною величиною, називають сигналом вимірюваної інформації.

Сигнал інформації, що вимірюється, має інформативний параметр, який функціонально пов'язаний з величиною, яка ви-

мірюється. Параметри сигналу, функціонально не пов'язані з вимірюваною величиною, називають неінформативними пара- метрами.

Всі електричні сигнали поділяються на аналогові і дискре- тні, детермінованими та випадковими.

Всі електричні сигнали поділяються на аналогові і дискре- тні, детермінованими та випадковими.

Аналогові сигнали – це сигнали з неперервними в часі ха- рактеристиками.

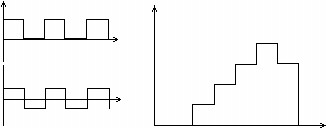

Прикладами аналогових повідомлень є музика, телевізійне зо- браження, мова (рис. 2.3).

U(t)

U(t)

t

Рисунок 2.3

Дискретні сигнали – представляють собою скінченну по- слідовність окремих символів, тривалість цієї послідовності скі- нченна.

Дискретні сигнали – представляють собою скінченну по- слідовність окремих символів, тривалість цієї послідовності скі- нченна.

Прикладом дискретного повідомлення є телеграма. Дис- кретні сигнали можуть бути бінарними або багаторівневими (рис. 2.4).

а) бінарні б) багаторівневі

Рисунок 2.4

Детермінований сигнал – сигнал, про який все відомо (амплітуда у кожний момент часу).

Детермінований сигнал – сигнал, про який все відомо (амплітуда у кожний момент часу).

Детерміновані сигнали поділяються на:

а) періодичні – сигнали, для яких виконується умова

а) періодичні – сигнали, для яких виконується умова

S (t)

S (t

k T)

де T=const – період, t – поточний час, k – ціле число. б) неперіодичні.

де T=const – період, t – поточний час, k – ціле число. б) неперіодичні.

Випадкові сигнали – сигнали, які описані випадковими функціями часу.

Значення і параметри випадкових сигналів заздалегідь не- відомі і можуть бути передбачені з деякою ймовірністю меншою за одиницю.

Основні характеристики сигналів

Ø тривалість сигналу (Tc).

Ø

амплітуда сигналу (Uc).

амплітуда сигналу (Uc).

Ø спектр сигналу

Fc.

Ø динамічний діапазон сигналу (Dc).

Динамічний діапазон за потужністю визначається за фор- мулою

D Pc max,

D Pc max,

| P |

c min

де Pc max– максимальна потужність сигналу,

Pc min– мінімальна

потужність сигналу.

Динамічний діапазон за потужністю вимірюється у неперах [Нп].

| P |

D lg

D lg

Pc max.

c

c min

Логарифмічний динамічний діапазон вимірюється у белах [Бел]. Десятковий логарифмічний динамічний діапазон за поту-

жністю:

D 10 lg

D 10 lg

Date: 2016-02-19; view: 480; Нарушение авторских прав