Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

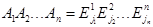

Композиция n независимых испытаний

|

|

Испытания (n - испытаний) называются независимыми, если неоднозначность исхода каждого из испытаний определена не связанными между собой группами факторов.

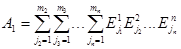

Событие A1: в результате проведения композиционного испытания в первом испытании произошло событие  . Тогда

. Тогда

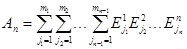

Событие An: в результате проведения композиционного испытания в первом испытании произошло событие  . Тогда

. Тогда

i=1,..., n

i=1,..., n

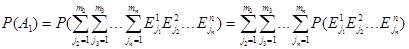

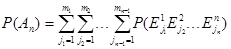

Рассмотрим событие:

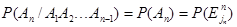

В силу определения независимости испытаний очевидно, что:

.

.

Следовательно:  .

.

На практике не строят композиционных пространств, а записывают формально неправильную формулу: P(A1A2...An)=P(A1)P(A2)...P(An).

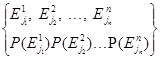

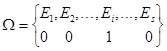

Композиционное пространство имеет вид:

j1=1,..., m1; j2=1,..., m2; jn=1,..., mn;

j1=1,..., m1; j2=1,..., m2; jn=1,..., mn;

Общая структура независимых событий в композиционном пространстве имеет вид:

| 1-е событие - | это событие, которое происходит в 1-м вероятностном пространстве |

| 2-е событие - | это событие, которое происходит во 2-м вероятностном пространстве |

| n - событие - | это событие, которое происходит в n-м вероятностном пространстве |

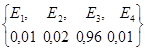

Рассмотрим два вероятностных пространства.

| I | II |

|

|

Очевидно, что неопределенность испытания до испытания в первом вероятностном пространстве выше, чем во втором. Действительно, до испытания в I нельзя ни одному из событий отдать предпочтения, а во II событие E3 происходит чаще.

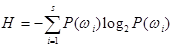

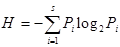

Энтропия - мера неопределенности исхода испытания (до испытания).

Первым, кто функционально задал выражение для энтропии был Шеннон.

,

,

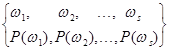

Для вероятностного пространства:

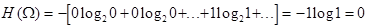

Энтропия задается выражением:  . Если P1=0, то Pi×logPi=0.

. Если P1=0, то Pi×logPi=0.

Самим показать, что:

1. Если вероятностное пространство не имеет определенности, т.е. какое-то из Pi=1, а остальные равны 0, то энтропия равна нулю.

1) Если элементарный исход равновероятен, т.е.  , то энтропия принимает максимальное значение.

, то энтропия принимает максимальное значение.

0£Pi£1,

1)

,

,

т.о. вероятности p1, p2,..., ps обращаются в ноль, например pi, которая равна 1. Но log1=0. Остальные числа также обращаются в 0, т.к.  .

.

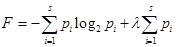

2) Докажем, что энтропия системы с конечным числом состояний достигае максимума, когда все состояния равновероятны. Для этого рассмотрим энтропию системы как функцию вероятностей p1, p2,..., ps и найдем условный экстремум этой функции, при условии, что  .

.

Пользуясь методом неопределенных множителей Лагранжа, будем искать экстремум функции:  .

.

Дифференцируя по p1, p2,..., ps и приравнивая производные нулю получим систему:

i=1,..., s

i=1,..., s

Откуда видно, что экстремум достигается при равных между собой p1.

Т.к.  , то p1= p2=,..., = ps= 1/s.

, то p1= p2=,..., = ps= 1/s.

Еденицей измерения энтропии является энтропия вероятностного пространства вида:

, которая называется 1 бит.

, которая называется 1 бит.

Неопределенность исхода испытания до испытания автоматически определяет информативность исхода испытания после испытания. Поэтому в битах также измеряется информативность исхода.

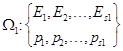

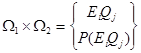

Рассмотрим два вероятностных пространства:

Проводим композицию двух испытаний. Композиционное пространство имеет вид:

i=1,..., s1 j=1,..., s2

i=1,..., s1 j=1,..., s2

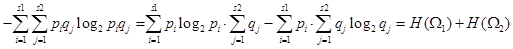

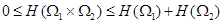

С точки зрения качественного анализа максимальная энтропия композиционного вероятностного пространства достигается тогда, когда испытания независимы. Найдем энтропию композиционного пространства для случая независимых испытаний.

Date: 2015-06-05; view: 479; Нарушение авторских прав