Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Тема 1.2 Определение количества информации

|

|

Основное содержание темы: Известны два подхода к измерению информации: содержательный и алфавитный. Алфавитный подход используется для измерения количества информации в тексте, представленном в виде последовательности символов некоторого алфавита. Такой подход не связан с содержанием текста. Количество информации в этом случае называется информационным объемом текста. С позиции содержательного подхода к измерению информации решается вопрос о количестве информации в сообщении, получаемом человеком.

Практическая работа 2. Решение задач с применением формулы Хартли

Цель работы: определение количества информации при содержательном подходе.

Краткое теоретическое обоснование:

Содержательный подход к измерению информации рассматривается в следующей ситуации:

1) человек получает сообщение о некотором событии; при этом заранее известна неопределенность знания человека об ожидаемом событии. Неопределенность знания может быть выражена либо числом возможных вариантов события, либо вероятностью ожидаемых вариантов события;

2) в результате получения сообщения неопределенность знания снимается: из некоторого возможного количества вариантов оказался выбранным один;

3) по формуле вычисляется количество информации в полученном сообщении, выраженное в битах.

Формула, используемая для вычисления количества информации, зависит от ситуаций, которых может быть две:

1. Все возможные варианты события равновероятны. Их число конечно и равно N.

2. Вероятности (p) возможных вариантов события разные и они заранее известны: {pi}, i = 1..N.

Если равновероятные события, то величины i и N связаны между собой формулой Хартли:

2i = N (1), где

i – количество информации в сообщении о том, что произошло одно из N равновероятных событий, измеряется в битах.

N — число возможных вариантов события.

Формула Хартли — это показательное уравнение. Если i — неизвестная величина, то решением уравнения (1) будет:

i = log2N (2)

Формулы (1) и (2) тождественны друг другу.

Оборудование: дидактические материалы по теме «Определение количества информации».

Последовательность выполнения:

1. Разберите ниже приведенные примеры задач с решениями. Запишите в тетрадь.

Задача 1. Найти количество информации в однозначном сообщении.

Решение:

N=1 => 2i=1 => i=0 бит

Задача 2. Измерить количество информации при ответе на вопрос: «Какие завтра намечаются осадки?»

Решение:

N=4 => 2i=4 => i=2 бит

Задача 3. Получено сообщение, объемом 10 бит. Какое количество сообщений возможно составить из полученных данных?

Решение:

i=10 => 210=1024 => N=1024 сообщения

2. Решите следующие задачи. Результат оформите в тетради.

1. Сколько информации содержит сообщение о том, что из колоды карт достали даму пик?

2. Сколько информации содержит сообщение о выпадении грани с числом 3 на шестигранном игральном кубике?

3. Некто задумал натуральное число в диапазоне от 1 до 32. Какое минимальное число вопросов надо задать, чтобы гарантированно угадать задуманное (выделенное) число. Ответы могут быть только «да» или «нет».

4. (Задача о фальшивой монете). Имеется 27 монет, из которых 26 настоящих и одна фальшивая. Каково минимальное число взвешиваний на рычажных весах, за которое можно гарантированно определить одну фальшивую монету из 27, используя то, что фальшивая монета легче настоящей. Рычажные весы имеют две чашки и с их помощью можно лишь установить, одинаково ли по весу содержимое чашек, и если нет, то содержимое какой из чашек тяжелее.

5. Сколько вопросов следует задать и как их нужно сформулировать, чтобы узнать с какого из 16 путей отправляется ваш поезд?

6. Какое количество информации получит первый игрок после первого хода второго игрока в игре "крестики - нолики" на поле 4 х 4?

7. После реализации одного из возможных событий получили количество информации равное 15 бит. Какое количество возможных событий было первоначально?

8. Определить стратегию угадывания одной карты из колоды из 32 игральных карт (все четыре шестерки отсутствуют), если на вопросы будут даны ответы "да" или "нет".

9. При игре в кости используется кубик с шестью гранями. Сколько бит информации получает игрок при каждом бросании кубика?

10. Сообщение о том, что ваш друг живет на 6 этаже несет 4 бита информации. Сколько этажей в доме.

11. Информационная емкость сообщения о том, что из корзины, где лежало некоторое количество разноцветных шаров, достали зеленый шар, несет в себе 0, 375 байта информации. Сколько в корзине было шаров.

12. В библиотеке 16 стеллажей. На каждом стеллаже по 8 полок Библиотекарь сказал Оле, что интересующая ее книга находится на 3 стеллаже, на 2-й сверху полке. Какое количество информации получила Оля?

13. В мешке находятся 30 шаров, из них 10 белых и 20 черных. Какое количество информации несет сообщение о том, что достали белый шар, черный шар?

14. В классе 30 человек. За контрольную работу по математике получено 6 пятерок, 15 четверок, 8 троек и 1 двойка. Какое количество информации в сообщении о том, что Иванов получил четверку?

15. В корзине лежат 32 клубка шерсти. Среди них – 4 красных. Сколько информации несет сообщение о том, что достали клубок красной шерсти?

16. В коробке лежат 64 цветных карандаша. Сообщение о том, что достали белый карандаш, несет 4 бита информации. Сколько белых карандашей было в корзине?

17. В ящике лежат перчатки (белые и черные). Среди них – 2 пары черных. Сообщение о том, что из ящика достали пару черных перчаток, несет 4 бита информации. Сколько всего пар перчаток было в ящике?

Контрольные вопросы:

1. Какой принцип положен в основу измерения количества информации?

2. Каким образом определяется единица количества информации при кибернетическом подходе?

3. Что принимается за минимальную единицу количества информации с точки зрения уменьшения неопределенности знаний в 2 раза?

4. В каких случаях применяют формулу Хартли?

Практическая работа 3. Вычисление количества информации на основе вероятностного подхода

Цель работы: совершенствование навыка по определению количества информации на основе вероятностного подхода

Краткое теоретическое обоснование: см. практическую работу 2.

Оборудование: дидактические материалы по теме «Определение количества информации»

Последовательность выполнения:

1. Разберите примеры решения задач

Задача 1. В языке племени Мумбо-Юмбо всего 20 разных слов. Сколько бит нужно, чтобы закодировать любое из этих слов?

Решение.

· По условию задачи у нас имеется 20 различных вариантов.

· Количество бит информации, необходимое для задания 20 равновероятных (одинаково принимаемых в расчет) вариантов можно рассчитать по формуле:

h=log2 20» 4,32 бит

или при выборе двухсимвольного алфавита для кодирования достаточно составить слово из 5 бит.

Задача 2. В доме 14 окон. Сколько различных сигналов можно подать, зажигая свет в окнах? Сколько бит информации несет в себе каждый такой сигнал?

Решение.

· Каждое окно несет в себе 1 бит информации: горит - не горит.

· Количество различных равновероятных сигналов, передаваемое с помощью 14 бит равно 214 = 16 384.

· Каждый из 16 384 сигналов несет в себе 14 бит информации.

2. Решите следующие задачи. Результат оформите в тетради.

1. В корзине лежат шары. Все разного цвета. Сообщение о том, что достали синий шар, несет 5 бит информации. Сколько всего шаров в корзине?

2. В соревновании участвуют 4 команды. Сколько информации в сообщении, что выиграла 3-я команда?

3. Группа школьников пришла в бассейн, в котором 4 дорожки для плавания. Тренер сообщил, что группа будет плавать на дорожке номер 3. Сколько информации получили школьники из этого сообщения?

4. В коробке 5 синих и 15 красных шариков. Какое количество информации несет сообщение, что из коробки достали синий шарик?

5. В коробке находятся кубики трех цветов: красного, желтого и зеленого, причем желтых в два раза больше красных, а зеленых на 6 больше, чем желтых. Сообщение о том, что из коробки случайно вытащили желтый кубик, содержало 2 бита информации. Сколько было зеленых кубиков?

6. Студенты группы изучают один из трех языков: английский, немецкий или французский, причем 12 студентов не учат английский. Сообщение, что случайно выбранный студент Петров изучает английский, несет log23 бит информации, а что Иванов изучает французский – 1 бит. Сколько студентов изучают немецкий язык?

7. В составе 16 вагонов, среди которых К – купейные, П – плацкартные и СВ – спальные. Сообщение о том, что ваш друг приезжает в СВ, несет 3 бита информации. Сколько в поезде вагонов СВ?

8. Студенческая группа состоит из 21 человека, которые изучают немецкий или французский языки. Сообщение о том, что студент A изучает немецкий язык, несет log23 бит информации. Сколько человек изучают французский язык?

9. Сколько информации несет сообщение о том, что было угадано число в диапазоне целых чисел от 684 до 811?

10. Для дистанционной передачи роботу различных команд применяются сигналы в 6 бит, причем сигнала в 5 бит недостаточно для передачи всех команд. Может ли общее количество всех команд для этого робота быть равно:

42 командам? 70 командам?

28 командам? 55 командам?

Какое наименьшее и какое наибольшее количество команд может получать робот?

11. Одиннадцать одноклассников решают голосованием, куда пойти после уроков. При голосовании каждый может быть либо “за” либо “против”. Сколько различных вариантов голосования может быть? Сколько бит потребуется, чтобы закодировать результаты голосования?

12. Какое минимальное количество бит информации требуется для кодирования всех букв русского алфавита?

13. Друзья в соседних домах договорились передавать друг другу сообщения в виде световых сигналов. Сколько лампочек им понадобиться для кодирования 10 различных слов?

14. В компьютерной игре распознаются 65 различных команд управления. Сколько бит требуется отвести в блоке памяти для кодирования каждой команды? Достаточно ли отведенных бит для кодирования 100 команд?

Контрольные вопросы:

1. Какие события являются равновероятностными?

2. Приведите примеры из жизни равновероятностных событий.

3. Какая формула связывает между собой количество возможных событий и количествоинформации?

4. Как зависит количество информации от количества возможных событий?

5. Верно ли высказывание о том что, чем больше количество возможных событий, тем меньше количество информации будет содержать сообщение о результатах опыта.

Ответ обоснуйте.

Практическая работа 4. Решение задач с применением формулы Шеннона

Цель работы: приобретение навыка по определению количества информации на основе вероятностного подхода

Краткое теоретическое обоснование:

Степень неопределенности – одна из характеристик случайного события, которую назвали энтропией. Обозначается - Н(α). За единицу энтропии принимается неопределенность, содержащаяся в опыте, имеющем два равновероятностных исхода. Существуют множества ситуаций, когда возможные события имеют различные вероятности реализации. Например, если монета не симметрична (одна сторона тяжелее другой), то при её бросании вероятности выпадения «орла» и «решки» будут различаться. Формулу для вычисления количества информации в случае различных вероятностей событий предложил К.Шеннон в 1948 году. В этом случае количество информации определяется по формуле:

pi log 2 pi, где I –количество информации, N –количество возможных событий, pi –вероятности отдельных событий. Вероятность события pi =1/N.

pi log 2 pi, где I –количество информации, N –количество возможных событий, pi –вероятности отдельных событий. Вероятность события pi =1/N.

Для решения задач такого типа нам необходимо знать формулу расчета вероятности исхода. Она выглядит так:

p=M/N,

где M – это величина, показывающая сколько раз произошло событие, N – это общее число возможных исходов какого-то процесса.

Необходимо знать, что в сумме все вероятности дают единицу или в процентном выражении 100%.

Оборудование: дидактические материалы по теме «Определение количества информации».

Последовательность выполнения:

1. Разберите примеры решения задач и запишите их в тетрадь.

Задача 1. Из колоды выбрали 16 карт (все “картинки” и тузы) и положили на стол рисунком вниз. Верхнюю карту перевернули. Верхняя перевернутая карта оказалась черной дамой. Сколько информации будет заключено в сообщении о том, какая именно карта оказалась сверху?

Решение.

В результате сообщения об исходе случайного события не наступает полной определенности: выбранная карта может иметь одну из двух черных мастей.

Так как информация есть уменьшение неопределенности знаний:

I = H1 – H2

До переворота карты неопределенность (энтропия) составляла

H1 = log2 N1, после него – H2 = log2 N2.

(причем в условиях задачи N1 = 16, а N2 = 2).

В итоге информация вычисляется следующим образом:

I = H1 – H2 = log2 N1 – log2 N2 = log2 N1/N2 = log2 16/2 = 3 бита.

Задача 2. Вероятность перового события составляет 0,5, а второго и третьего 0,25. Какое количество информации мы получим после реализации одного из них?

Решение.

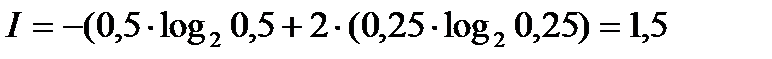

Р1=0,5; Р2=Р3=0,25 Þ  бита.

бита.

Задача 3. Определить количество информации, получаемое при реализации одного из событий, если бросают

а) несимметричную четырехгранную пирамидку;

б) симметричную и однородную четырехгранную пирамидку.

Решение.

а) Будем бросать несимметричную четырехгранную пирамидку.

Вероятность отдельных событий будет такова:

р1 = 1 / 2,

р2 = 1 / 4,

р3 = 1 / 8,

р4 = 1 / 8,

тогда количество информации, получаемой после реализации одного из этих событий, рассчитывается по формуле Шеннона т.к. неравновероятностные события:

I = -(1 / 2 log2 1/2 + 1 / 4 log21/4 + 1 / 8 log21/8 + 1 / 8 log2 1/8) = 1 / 2 + 2 / 4 + + 3 / 8 + 3 / 8 = 14/8 = 1,75 (бит).

б) Теперь рассчитаем количество информации, которое получится при бросании симметричной и однородной четырехгранной пирамидки, т.е. равновероятностные события:

I = log2 4 = 2 (бит).

2. Решите следующие задачи. Результат оформите в тетради.

1. В классе 30 человек. За контрольную работу по информатике получено 15 пятерок, 6 четверок, 8 троек и 1 двойка. Какое количество информации несет сообщение о том, что Андреев получил пятерку?

2. В непрозрачном мешочке хранятся 10 белых, 20 красных, 30 синих и 40 зеленых шариков. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика?

3. За контрольную работу по информатике получено 8 пятерок, 13 четверок, 6 троек и 2 двойки. Какое количество информации получил Васечкин при получении тетради с оценкой?

4. Известно, что в ящике лежат 20 шаров. Из них 10 — черных, 4 — белых, 4 — желтых и 2 — красный. Какое количество информации несёт сообщения о цвете вынутого шара?

5. В сейфе банкира Богатеева лежат банкноты достоинством 1, 10 или 100 талеров каждая. Банкир раскрыл свой сейф и наугад вытащил из него одну банкноту. Информационный объем сообщения "Из сейфа взята банкнота достоинством в 10 талеров" равен 3 бита. Количество информации, содержащееся в сообщении "Из сейфа взята банкнота достоинством не в 100 талеров", равно 3-log25 бит. Определите информационный объем зрительного сообщения о достоинстве вынутой банкноты.

3. Выполните упражнение

Ниже приведены 11 событий:

1. Первый встречный человек мужского пола.

2. За понедельником будет вторник.

3. За контрольную работу можно получить «отлично».

4. К телефону из пяти членов семьи подойдет младший сын.

5. После 31 января наступит 1 февраля.

6. После лета буде зима.

7. Каждый из 15 учеников, посещающих данные занятия, поступит на математическую специальность.

8. В лотерее победит билет с номером 777777.

9. Подброшенная монетка упадет гербом вверх.

10. На подброшенном кубике выпадет шесть очков.

11. Из выбираемых наугад карточек с цифрами выберем карточку с цифрой 5.

Задание среди 11 событий записать номера тех, которые:

1. Достоверные _________________________________________________

2. Невозможные ________________________________________________

3. Неопределенные______________________________________________

4. Среди неопределенных указать те, которые имеют 2 равновозможных исхода ______________________________________________________

5. Неопределенные события расставить в порядке возрастания числа равновероятных исходов _______________________________________

6. Назвать событие более неопределенное____________________________

7. Назвать событие менее неопределенное. ___________________________

8. Учитывая задания № 6 и № 7, установить зависимость степени неопределенности от числа равновероятных исходов. ____________________________________________________________

9. Сделать тот же вывод, используя понятие вероятности. ____________________________________________________________

Контрольные вопросы:

1. Какие бывают события?

2. Приведите примеры равновероятных и неравновероятных событий?

3. Как определить вероятность выполнения определенного события?

4. При каких событиях применяют формулу Шеннона для определения количества информационного сообщения?

5. При каком условии формула Хартли становится частным случаем формулы Шеннона?

Практическая работа 5. Решение задач на определение количества информации

Цель работы: приобретение навыка по определению количества информации на основе вероятностного и содержательного подхода

Краткое теоретическое обоснование: В качестве основной характеристики сообщения теория информации принимает величину, называемую количеством информации. Это понятие не затрагивает смысла и важности передаваемого сообщения, а связано со степенью его неопределенности.

Клод Шеннон определил количество информации через энтропию - величину, известную в термодинамике и статистической физике как мера разупорядоченности системы, а за единицу количества информации принял то, что впоследствии назвали битом (bit). Количество информации, приходящееся на один элемент сообщения (знак, букву), называется энтропией. Энтропия и количество информации измеряются в одних и тех же единицах – в битах.

Так как современная информационная техника базируется на элементах, имеющих два устойчивых состояния, то обычно выбирают основание логарифма равным двум, т.е. энтропию выражают как: H0 = log2m.

В общем случае количество энтропии H произвольной системы X (случайной величины), которая может находиться в m различных состояниях x1, x2, … xm c вероятностями p1, p2, … pm, вычисляют по формуле Шеннона.

Оборудование: дидактические материалы по теме «Определение количества информации».

Последовательность выполнения:

1. Разберите примеры решения задач

Задача 1. Определите количество информации, которое содержится в телевизионном сигнале, соответствующем одному кадру развертки. Пусть в кадре 625 строк, а сигнал, соответствующий одной строке, представляет собой последовательность из 600 случайных по амплитуде импульсов, причем амплитуда импульса может принять любое из 8 значений с шагом

в 1 В.

Решение.

В рассматриваемом случае длина сообщения, соответствующая одной строке, равна числу случайных по амплитуде импульсов в ней: n = 600.

Количество элементов сообщения (знаков) в одной строке равно числу значений, которое может принять амплитуда импульсов в строке m = 8.

Количество информации в одной строке: I = n log m = 600 log 8, а количество информации

в кадре: I = 625 I = 625 600 log 8 = 1,125 =106 бит

Задача 2. В велокроссе участвуют 119 спортсменов. Специальное устройство регистрирует прохождение каждым из участников промежуточного финиша, записывая его номер с использованием минимально возможного количества бит, одинакового для каждого спортсмена. Каков информационный объем сообщения, записанного устройством, после того как промежуточный финиш прошли 70 велосипедистов?

1) 70 бит 2) 70 байт 3) 490 бит 4) 119 байт

Решение.

1) велосипедистов было 119, у них 119 разных номеров, то есть, нам нужно закодировать 119 вариантов;

2) по таблице степеней двойки находим, что для этого нужно минимум 7 бит (при этом можно закодировать 128 вариантов, то есть, еще есть запас); итак, 7 бит на один отсчет;

3) когда 70 велосипедистов прошли промежуточный финиш, в память устройства записано 70 отсчетов;

4) поэтому в сообщении 70*7 = 490 бит информации (ответ 3).

2. Решите следующие задачи. Результат оформите в тетради.

1. В зоопарке 32 обезьяны живут в двух вольерах, А и Б. Одна из обезьян – альбинос (вся белая). Сообщение «Обезьяна-альбинос живет в вольере А» содержит 4 бита информации. Сколько обезьян живут в вольере Б?

2. В корзине лежат 32 клубка шерсти, из них 4 красных. Сколько бит информации несет сообщение о том, что достали клубок красной шерсти?

3. Двое играют в «крестики-нолики» на поле 4 на 4 клетки. Какое количество информации получил второй игрок, узнав ход первого игрока?

4. В некоторой стране автомобильный номер длиной 7 символов составляется из заглавных букв (всего используется 26 букв) и десятичных цифр в любом порядке. Каждый символ кодируется одинаковым и минимально возможным количеством бит, а каждый номер – одинаковым и минимально возможным количеством байт. Определите объем памяти, необходимый для хранения 20 автомобильных номеров.

5. В велокроссе участвуют 678 спортсменов. Специальное устройство регистрирует прохождение каждым из участников промежуточного финиша, записывая его номер с использованием минимально возможного количества бит, одинакового для каждого спортсмена. Каков информационный объем сообщения, записанного устройством, после того как промежуточный финиш прошли 200 велосипедистов?

Контрольные вопросы:

1. Дайте определение энтропии.

2. Как связаны между собой понятия количества информации и энтропии?

3. Какие подходы к определению количества информации вам известны?

4. В чем смысл каждого из подходов к определению количества информации?

5. Что называется измерением информации?

6. Какие способы определения количества информации существуют?

7. Дайте определение количества информации.

Практическая работа 6. Решение задач на определение объема информации

Цель работы: приобретение навыка по определению количества информации на основе алфавитного подхода

Краткое теоретическое обоснование:

Алфавитный подход основан на том, что всякое сообщение можно закодировать с помощью конечной последовательности символов некоторого алфавита.

Алфавит – упорядоченный набор символов, используемый для кодирования сообщений на некотором языке.

Мощность алфавита – количество символов алфавита. Двоичный алфавит содержит 2 символа, его мощность равна двум. Сообщения, записанные с помощью символов ASCII, используют алфавит из 256 символов. Сообщения, записанные по системе UNICODE, используют алфавит из 65 536 символов.

Чтобы определить объем информации в сообщении при алфавитном подходе, нужно последовательно решить задачи:

1. Определить количество информации (i) в одном символе по формуле

2i = N, где N — мощность алфавита.

2. Определить количество символов в сообщении (m).

3. Вычислить объем информации по формуле: I = i * K.

Количество информации во всем тексте (I), состоящем из K символов, равно произведению информационного веса символа на К:

I = i * К.

Эта величина является информационным объемом текста.

Единицы измерения информации

Основная единица измерения информации –бит. 8 бит составляют 1 байт. Наряду с байтами для измерения количества информации используются более крупные единицы:

1 Кбайт = 210 байт = 1024 байта;

1 Мбайт = 210 Кбайт = 1024 Кбайт;

1 Гбайт = 210 Мбайт = 1024 Мбайт.

1 Терабайт (Тб) = 1024 Гбайт = 240 байта,

1 Петабайт (Пб) = 1024 Тбайта = 250 байта.

Оборудование: дидактические материалы по теме «Определение количества информации».

Последовательность выполнения:

1. Разберите примеры решения задач и запишите их в тетрадь.

Задача 1. Для записи текста использовался 256-символьный алфавит. Каждая страница содержит 32 строки по 64 символа в строке. Какой объем информации содержат 5 страниц этого текста?

Решение:

N=256, => 2i = 256, => i=8 bit

k=32*64*5 символов

I=i*k=8*32*64*5 bit = 8*32*64*5/8 b = 32*64*5/1024 kb = 10 kb

Задача 2. Можно ли уместить на одну дискету книгу, имеющую 432 страницы, причем на каждой странице этой книги 46 строк, а в каждой строке 62 символа?

Решение:

Т.к. речь идет о книге, напечатанной в электронном виде, то мы имеем дело с компьютерным языком. Тогда N=256, => 2i = 256, => i=8 bit

k = 46*62*432 символов

I = i*k = 8*46*62*432 bit = 8*46*62*432/8 b = 46*62*432/1024 kb = 1203,1875 kb = 1,17 Mb

Т.к. объем дискеты 1,44 Mb, а объем книги 1,17 Mb, то она на дискету уместится.

Задача 3. Скорость информационного потока – 20 бит/с. Сколько минут потребуется для передачи информации объемом в 10 килобайт.

Решение:

t = I/v = 10 kb/ 20 бит/c = 10*1024 бит/ 20 бит/c = 512 c = 8,5 мин

Задача 4. Лазерный принтер печатает со скоростью в среднем 7 Кбит в секунду. Сколько времени понадобится для распечатки 12-ти страничного документа, если известно, что на одной странице в среднем по 45 строк, в строке 60 символов.

Решение:

Т.к. речь идет о документе в электронном виде, готовым к печати на принтере, то мы имеем дело с компьютерным языком. Тогда N=256, => 2i = 256, => i=8 bit

K = 45*60*12 символов

I = i*k = 8*45*60*12 bit = 8*45*60*12/8 b = 45*60*12/1024 kb = 31,6 kb

t = I/v = 31,6 kb/ 7 Кбит/c = 31,6*8 kбит/ 7 Кбит/c = 36 c

Задача 5. Автоматическое устройство осуществило перекодировку информационного сообщения на русском языке, из кодировки Unicode, в кодировку КОИ-8. При этом информационное сообщение уменьшилось на 480 бит. Какова длина сообщения?

Решение:

Объем 1 символа вкодировке КОИ-8 равен 1 байту, а в кодировке Unicode – 2 байтам.

Пусть x – длина сообщения, тогда IКОИ-8 = 1*x b, а IUnicode = 2*x b.

Получаем 2*x8 bит – 1*x*8 бит = 480 бит, 8x = 480, х = 60 символов в сообщении.

2. Решите следующие задачи. Результат оформите в тетради.

1. Некоторый алфавит содержит 128 символов. Сообщение содержит 10 символов. Определите объем сообщения.

2. Считая, что один символ кодируется 8-ю битами, оцените информационный объем следующей поговорки в кодировке КОИ-8: Верный друг лучше сотни слуг.

3. Один и тот же текст на русском языке записан в различных кодировках. Текст, записанный в 16-битной кодировке Unicode, на 120 бит больше текста, записанного в 8-битной кодировке КОИ-8. Сколько символов содержит текст?

4. Сколько гигабайт содержит файл объемом 235 бит?

5. Текстовый файл copia.txt имеет объем 40960 байт. Сколько таких файлов можно записать на носитель объемом 5 Мбайт?

6. К текстовому сообщению объемом 46080 байт добавили рисунок объемом 2,5 Мбайт. Сколько кбайт информации содержит полученное сообщение?

7. В алфавите некоторого языка два символа Х и О. Слово состоит из четырех символов, например: ООХО, ХООХ. Укажите максимально возможное количество слов в этом языке.

8. Для записи текста использовался 64-символьный алфавит. Сколько символов в тексте, если его объем равен 8190 бита?

9. Укажите наибольшее натуральное число, которое можно закодировать 8 битами (если все числа кодируется последовательно, начиная с единицы).

10. Некоторый алфавит содержит 2 символа. Сообщение занимает 2 страницы, на каждой по 16 строк, и в каждой строке по 32 символа. Определите объем сообщения.

11. Сколько бит информации содержится в сообщении объемом 1/4 килобайта?

12. Найдите х из следующего соотношения: 8х бит = 16 Мбайт.

13. Цветное растровое графическое изображение с палитрой 256 цветов имеет размер 64х128 пикселей. Какой информационный объем имеет изображение?

14. Для хранения растрового изображения размером 64х128 пикселей отвели 4 Кбайта памяти. Каково максимально возможное количество цветов в палитре изображения?

Контрольные вопросы:

1. Как измеряется информация при содержательном подходе?

2. В чем заключается алфавитный подход к определению количества информации?

3. Что такое алфавит? Что называется мощностью алфавита? Что называется объемом информации?

4. Чему равен информационный вес символа компьютерного алфавита?

5. Как посчитать количество информации в сообщении с помощью алфавитного подхода?

6. Почему информационная емкость русской буквы «а» больше информационной ёмкости английской буквы?

7. Какие единицы измерения информации существуют?

Практическая работа7. Комплексная работа по определению количества информации

Цель работы: контроль навыков определения количества информации.

Краткое теоретическое обоснование: см.практические работы 1-6.

Оборудование: Контрольные материалы из КОС по дисциплине «Основы теории информации»

Последовательность выполнения:

· Выполните ТЗ№1. Тест 3. Единицы измерения информации. В тесте необходимо выбрать только один ответ из предложенных вариантов. Выполнять тест лучше самостоятельно, без применения конспектов, учебников и прочей вспомогательной литературы.

· Выполните ПЗ№2. Задачи 1-10.

Date: 2015-09-02; view: 10573; Нарушение авторских прав