Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

О недифференцируемой оптимизации

|

|

Недифференцируемая оптимизация – это обширная область современной теории экстремальных задач и вычислительной математики. Обсудим возможные подходы к исследованию и ре-

шению негладких экстремальных задач на примере минимизации выпуклых недифференцируемых функций.

Пусть выпуклая функция  определена на

определена на  и не является всюду дифференцируемой. Несмотря на то, что в любой точке пространства существует производная выпуклой функции

и не является всюду дифференцируемой. Несмотря на то, что в любой точке пространства существует производная выпуклой функции  по любому направлениям, в точках недифференцируемости градиент не существует. Поэтому определены различные обобщения этого понятия, которые для некоторых целей могут быть «заменителем» градиента. В частности, этим целям служат понятия субградиента и субдифференциала.

по любому направлениям, в точках недифференцируемости градиент не существует. Поэтому определены различные обобщения этого понятия, которые для некоторых целей могут быть «заменителем» градиента. В частности, этим целям служат понятия субградиента и субдифференциала.

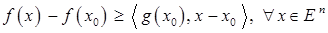

Определение 1. Вектор  называется субградиентом функции f в точке

называется субградиентом функции f в точке  , если выполняется неравенство

, если выполняется неравенство

.

.

Множество  субградиентов называется субдифференциалом функции f в точке

субградиентов называется субдифференциалом функции f в точке  .

.

В любой точке  субдифференциал выпуклой функции

субдифференциал выпуклой функции  – непустое выпуклое замкнутое и ограниченное множество. Если функция

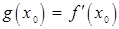

– непустое выпуклое замкнутое и ограниченное множество. Если функция  дифференцируема в точке

дифференцируема в точке  , то субградиентом является единственный вектор

, то субградиентом является единственный вектор  . Субградиенты используются, в частности, для изучения экстремальных свойств выпуклых функ-

. Субградиенты используются, в частности, для изучения экстремальных свойств выпуклых функ-

ций. В терминах субдифференциалов получены общие необходимые и достаточные условия экстремума. На основе субградиентов построены методы минимизации, обобщающие градиентные методы.

Важной и непростой задачей является вычисление субдифференциала или отдельно взятых субградиентов. Нет простых процедур, позволяющих вычислять субдифференциалы в общем случае. Однако для некоторых классов выпуклых функций построить  и найти какой-либо субградиент

и найти какой-либо субградиент  не представляет особой сложности.

не представляет особой сложности.

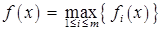

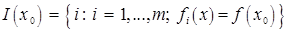

В качестве примера рассмотрим функцию максимума  . Предположим, что все функции

. Предположим, что все функции  – выпуклые и дифференцируемые. Обозначим через

– выпуклые и дифференцируемые. Обозначим через

.

.

Тогда  .

.

В терминах субградиентов необходимое и достаточное условие безусловного минимума выпуклой функции  в точке

в точке  имеет вид следующего включения:

имеет вид следующего включения:

.

.

Познакомимся далее вкратце с субградиентным методом безусловной минимизации или,

как его еще называют, с методом обобщенного градиентного спуска.

Пусть  – определенная на

– определенная на  выпуклая функция,

выпуклая функция,  – произвольный вектор. Начиная с вектора

– произвольный вектор. Начиная с вектора  , последовательность приближений строится по правилу

, последовательность приближений строится по правилу

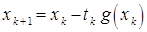

,

,  (1)

(1)

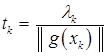

где  ,

,  , числовая последовательность

, числовая последовательность  ,

,  , такова, что

, такова, что  ,

,  и ряд

и ряд  расходится.

расходится.

Заметим, что последовательность  , генерируемая субградиентным методом, вообще го-воря, не является релаксационной. При некоторых дополнительных предположениях о функции

, генерируемая субградиентным методом, вообще го-воря, не является релаксационной. При некоторых дополнительных предположениях о функции  последовательность

последовательность  – минимизирующая. Последовательность

– минимизирующая. Последовательность  может находиться по различным правилам. Например,

может находиться по различным правилам. Например,  , где с – произвольная положительная константа.

, где с – произвольная положительная константа.

Метод прост в реализации (если, конечно, просто вычисляются субградиенты), однако скорость сходимости и достигаемая точность решения существенно зависят от многих факторов и поэтому успешное применение метода не всегда возможно.

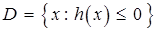

Субградиентный метод легко обобщается и для решения условно экстремальных задач. Пусть требуется минимизировать выпуклую функцию  на множестве

на множестве  , где

, где  – выпуклая на

– выпуклая на  функция.

функция.

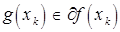

Так же, как в только что приведенном методе, последовательность приближений строится, начиная с произвольного вектора  , по формуле (1) с той лишь разницей, что вектор

, по формуле (1) с той лишь разницей, что вектор  является субградиентом функции

является субградиентом функции  , то есть

, то есть  , если

, если  , и субградиентом функции

, и субградиентом функции  , то есть

, то есть  , если

, если  .

.

| <== предыдущая | | | следующая ==> |

| | | ВВЕДЕНИЕ. Эта работа впервые появилась в сборнике трудов по прикладной психиатрии, который давно уже разошелся; и если теперь |

Date: 2015-09-19; view: 994; Нарушение авторских прав