Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Понятие об энтропии информации

|

|

Энтропия — это количество информации, приходящейся на одно элементарное сообщение источника, вырабатывающего статистически независимые сообщения.

Информацио́нная энтропи́я — мера неопределённости или непредсказуемости информации, неопределённость появления какого-либо символа первичного алфавита. При отсутствии информационных потерь численно равна количеству информации на символ передаваемого сообщения.

Например, в последовательности букв, составляющих какое-либо предложение на русском языке, разные буквы появляются с разной частотой, поэтому неопределённость появления для некоторых букв меньше, чем для других. Если же учесть, что некоторые сочетания букв (в этом случае говорят об энтропии  -го порядка) встречаются очень редко, то неопределённость уменьшается еще сильнее.

-го порядка) встречаются очень редко, то неопределённость уменьшается еще сильнее.

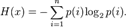

Информационная двоичная энтропия для независимых случайных событий  с

с  возможными состояниями (от

возможными состояниями (от  до

до  ,

,  — функция вероятности) рассчитывается по формуле

— функция вероятности) рассчитывается по формуле

Эта величина также называется средней энтропией сообщения. Величина  называется частной энтропией, характеризующей только

называется частной энтропией, характеризующей только  -e состояние.

-e состояние.

Таким образом, энтропия события  является суммой с противоположным знаком всех относительных частот появления события

является суммой с противоположным знаком всех относительных частот появления события  , умноженных на их же двоичные логарифмы. Это определение для дискретных случайных событий можно расширить для функции распределения вероятностей.

, умноженных на их же двоичные логарифмы. Это определение для дискретных случайных событий можно расширить для функции распределения вероятностей.

Date: 2015-06-11; view: 474; Нарушение авторских прав