Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

История возникновения искусственных нейронных сетей

|

|

В качестве научного предмета искусственные нейронные сети впервые заявили о себе в 40-е годы. Стремясь воспроизвести функции человеческого мозга, исследователи создали простые аппаратные (а позже программные) модели биологического нейрона и системы его соединений, которые получили название персептроны. Когда нейрофизиологи достигли более глубокого понимания нервной системы человека, эти ранние попытки стали восприниматься как весьма грубые аппроксимации. Тем не менее, именно на персептронах были достигнуты первые впечатляющие результаты, стимулировавшие дальнейшие исследования, приведшие к созданию более изощренных сетей. Первое систематическое изучение искусственных нейронных сетей было предпринято Маккалокком и Питтсом в 1943 г. Простая нейронная модель, показанная на рисунке ниже, использовалась в большей части их работы. На вход поступает только двоичный сигнал, т.е. либо 0 либо 1. Элемент ∑ умножает каждый вход ХN на вес WN и суммирует взвешенные входы. Если эта сумма больше заданного порогового значения, выход равен единице, в противном случае – нулю (рис. 5).

|

Рис. 5. Простая нейронная модель

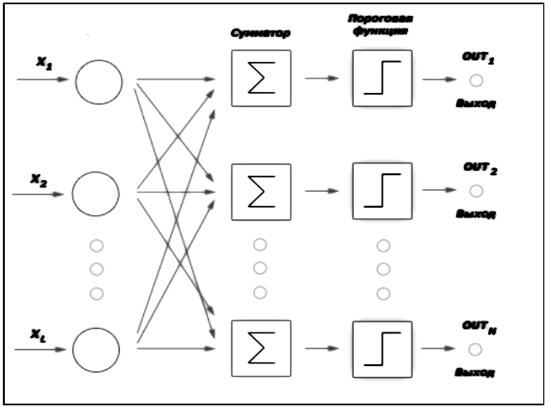

Именно такие системы и множество им подобных называются – персептронами. Персептроны состоят из одного слоя (т.е. количество слоев нейронов между входом X и выходом OUT равно одному) искусственных нейронов, соединенных с помощью весовых коэффициентов с множеством входов (см. рис. 6).

Рис. 6. Пример персептрона

Вершины-круги в левой части рисунка служат лишь для распределения входных сигналов. Они не выполняют каких- либо вычислений, и поэтому не считаются слоем. По этой причине они обозначены в виде круга, чтобы отличать их от вычисляющих нейронов (сумматоров), обозначенных квадратами.

Теория персептронов является основой для многих других типов искусственных нейронных сетей, а сами персептроны являются логической исходной точкой для изучения искусственных нейронных сетей [5].

Фрэнк Розенблатт предложил схему устройства, моделирующего процесс человеческого восприятия, и назвал его «персептроном». Персептрон передавал сигналы от фотоэлементов, представляющих собой сенсорное поле, в блоки электромеханических ячеек памяти. Эти ячейки соединялись между собой случайным образом в соответствии с принципами коннективизма. В 1957 году в Корнелльской Лаборатории Аэронавтики успешно было завершено моделирование работы персептрона на компьютере IBM 704, а два года спустя, 23 июня 1960 года в Корнелльском университете, был продемонстрирован первый нейрокомпьютер — «Марк-1», который был способен распознавать некоторые буквы английского алфавита [2]. Чтобы «научить» персептрон классифицировать образы, был разработан специальный итерационный метод обучения проб и ошибок, напоминающий процесс обучения человека — метод коррекции ошибки [3]. Кроме того, при распознании той или иной буквы персептрон мог выделять характерные особенности буквы, статистически чаще встречающиеся, чем малозначимые отличия в индивидуальных случаях. Тем самым персептрон был способен обобщать буквы, написанные различным образом (почерком), в один обобщённый образ. Однако возможности персептрона были ограниченными: машина не могла надежно распознавать частично закрытые буквы, а также буквы иного размера, расположенные со сдвигом или поворотом, нежели те, которые использовались на этапе ее обучения.

1.3 Сфера применения персептрона

В настоящее время принципы персептронов используются:

· при построении специальных технических устройств;

· при создании программ для ЭВМ, позволяющих моделировать работу персептронов в режимах обучения и распознавания зрительных (рукописный текст, рисунки и портреты), слуховых и других образов.

· в медицинском и техническом диагнозах;

· интерпретации геофизических данных,аэрофотосъёмке;

· прогнозу погоды

· совершенствование промышленных роботов.

1.4 Обучение персептрона

Персептрон - это некоторый инструмент, который способен "запоминать" ("обучиться") - какой образ относится к какому классу. После такого "обучения", в идеале, он должен уметь правильно "узнавать" и другие образы, не входившие в обучающее множество, но достаточно похожие на них, или сообщать, что образ не похож ни на один из множества обучающих образов. Степень "достаточной похожести" определяется удачностью выбора признаков его множества. А способность персептрона "обучиться" зависит от разделимости признаков множества, то есть от уникальности наборов признаков с точностью до класса (иными словами - не пересекаются ли области, ограничивающие свои классы).

Среди всех интересных свойств искусственных нейронных сетей ни одно не захватывает так воображения, как их способность к обучению. Их обучение до такой степени напоминает процесс интеллектуального развития человеческой личности, что может показаться, будто нами достигнуто глубокое понимание этого процесса. Возможности обучения искусственных нейронных сетей ограничены, и нужно решить много сложных задач, чтобы определить, находимся ли мы на правильном пути.

Цель обучения

Сеть обучается, чтобы для некоторого множества входов давать желаемое (или, по крайней мере, сообразное с ним) множество выходов. Каждое такое входное (или выходное) множество рассматривается как вектор. Обучение осуществляется путем последовательного предъявления входных векторов с одновременной подстройкой весов в соответствии с определенной процедурой. В процессе обучения веса сети постепенно становятся такими, чтобы каждый входной вектор вырабатывал выходной вектор.

Различают алгоритмы обучения с учителем, без учителя и смешанное.

· Обучение с учителем предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором, разность (ошибка) с помощью обратной связи подается в сеть, и веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку. Векторы обучающего множества предъявляются последовательно, ошибки вычисляются и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемо низкого уровня.

· Обучение без учителя является намного более правдоподобной моделью обучения для биологической системы, она не нуждается в целевом векторе для выходов и, следовательно, не требует сравнения с предопределенными идеальными ответами. Обучающее множество состоит лишь из входных векторов. Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т.е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения, следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы. Предъявление на вход вектора из данного класса даст определенный выходной вектор, но до обучения невозможно предсказать, какой выход будет производиться данным классом входных векторов. Следовательно, выходы подобной сети должны трансформироваться в некоторую понятную форму, обусловленную процессом обучения. Это не является серьезной проблемой. Обычно не сложно идентифицировать связь между входом и выходом, установленную сетью.

· При смешанном обучении часть весов определяется посредством обучения с учителем, а другая часть получается с помощью алгоритмов самообучения [1].

2. Программирование персептрона

2.1 Алгоритм работы персептрона

Обучение персептрона состоит в постройке весовых коэффициентов wi, где I=0,1.....n. Персептрон после обучения должен разделять все предлагаемые ему для распознавания образы на два класса: одному из которых на выходе будет соответствовать нулевое значение, а другому — единичное.

Шаг 1. Датчиком случайных чисел всем синаптическим весам wj (j=1,…, n) и порогу чувствительности нейрона присвоить некоторые малые случайные значения.

Шаг 2. Предъявить персептрону «Крестик» или «Нолик».

Шаг 3. Нейрон выполняет взвешенное суммирование входных сигналов

и вырабатывает выходной сигнал y=1 или y=0.

Шаг 4,а. Если выходной сигнал правильный, то перейти на шаг 2.

Шаг 4,б. Если выходной сигнал неправильный и равен нулю, то увеличить веса активных входов, добавить каждому j-му синаптическому весу величину j-го входного сигнала.

Шаг 4,в. Если выходной сигнал неправильный и равен единице, то уменьшить веса активных входов.

Шаг 5. Перейти на Шаг 2 или завершить процесс обучения.

Этот алгоритм удивительным образом напоминают процесс обучения ребёнка или школьника методом «поощрения-наказания» (или дрессировки животного методом «кнута и пряника»). Как и в случаях с ребёнком, обучаемом этим методом, алгоритм обучения персептрона за конечное число попыток может привести к цели – персептрон в конце концов усвоит необходимые знания, закодирует их в виде конкретных значений матрицы сил синаптических связей wj и, таким образом, научится различать «Крестик» или «Нолик».Естественно возникает вопрос, всегда ли алгоритм обучения персептрона приводит к желаемому результату. Ответ на этот вопрос дает теорема сходимости персептрона:

Если существует множество значений весов, которые обеспечивают конкретное различение образов, то в конечном итоге алгоритм обучения персептрона приводит либо к этому множеству, либо к эквивалентному ему множеству, такому, что данное различение образов будет достигнуто.

2.2 Демонстрация обучения на составленной компьютерной программе

С помощью программы можно обучить персептрон распознавания «крестиков» и «ноликов». Основные окна программа показаны на рис. 7.

Обучение происходит следующим образом. Пользователь, который выступает в качестве учителя, рисует с помощью мыши изображение «крестика» или «нолика». Затем он нажимает на кнопку «распознать», после чего происходит формирование бинарного образа (окрашенной ячейке соответствует 1, неокрашенной соответствует 0).

На основе данных на входах и весовых коэффициентов генерируется результат. При получении на выходе 1 считается, что персептрон распознал «крестик», при получении 0 — «нолик». Результат распознавания отражается во втором окне. В случае ошибки персептрона пользователь нажимает в окне вывод результата на кнопку «Нет», указывая тем самым программе правильный ответ (противоположный полученному программой), который она запоминает. При правильном ответе программы пользователь нажимает на кнопку «Да», подтверждая верность результата.

Рис. 7. Основные окна программы

2.3 Результаты обучения персептрона

После выполнения достаточно большого количества итераций персептрон научился безошибочно распознавать образы, участвовавшие в обучении. Таким образом, была подтверждена гипотеза о том, что компьютер, построенный по образу и подобию человеческого мозга, будет способен решать интеллектуальные задач и, в частности – решать задачу распознавания образов.

Помимо того, что персептрон научился распознавать знакомые образы, т.е. те образы, которые демонстрировались ему в процессе обучения, он успешно справлялся с распознаванием образов, которые «видел» впервые. Выяснилось, что персептрон оказался способным распознавать образы, с небольшими искажениями.

ЗАКЛЮЧЕНИЕ

Современные искусственные нейронные сети представляют собой устройства, использующие огромное число искусственных нейронов и связей между ними. Несмотря на то, что конечная цель разработки нейронных сетей— полное моделирование процесса мышления человека так и не была достигнута, уже сейчас они применяются для решения очень многих задач обработки изображений, управления роботами и непрерывными производствами, для понимания и синтеза речи, для диагностики заболеваний людей и технических неполадок в машинах и приборах, для предсказания курсов валют и т.д.

В отличие от цифровых микропроцессорных систем, представляющих собой сложные комбинации процессорных и запоминающих блоков, основанные на использовании нейронных сетей нейропроцессоры, содержат память, распределенную в связях между очень простыми процессорами. Тем самым основная нагрузка на выполнение конкретных функций процессорами ложится на архитектуру системы, детали которой в свою очередь определяются межнейронными связями. Основанные на такой структуре прототипы нейрокомпьютеров дают стандартный способ решения многих нестандартных задач.

Следует отметить, что основное назначение персептронов - решать задачи классификации. Они великолепно справляются с задачей классификации линейно отделимых векторов; сходимость гарантируется за конечное число шагов. Длительность обучения чувствительна к выбросам длины отдельных векторов, но и в этом случае решение может быть построено. Однослойный персептрон может классифицировать только линейно отделимые векторы. Возможные способы преодолеть эту трудность предполагают либо предварительную обработку с целью сформировать линейно отделимое множество входных векторов, либо использование многослойных персептронов. Можно также применить другие типы нейронных сетей, например линейные сети или сети с обратным распространением, которые могут выполнять классификацию линейно неотделимых векторов входа.

В ходе выполнения курсовой работы было сделано:

1. Рассмотрено понятие персептрона и классификация нейронных сетей

2. Изучена история возникновения искусственных нейронных сетей.

3. Рассмотрена сфера применения персептрона.

4. Показаны различные методы обучение персептрона.

5. Описан алгоритм работы компьютерной программы «Персептрон».

6. Представлена демонстрация обучения программы.

Таким образом, можно утверждать, что была достигнута цель курсовой работы и успешно решены все задачи.

Литература

1. Интуит / Национальный Открытый Университет «ИНТУИТ» / © НОУ «ИНТУИТ»,2003 – 2013. – Режим доступа: http://www.intuit.ru/, свободный. — Загл. с экрана.

2. Конспект лекций по курсу / Основы проектирования систем искусственного интеллекта/ © Сотник С. Л., 1997-1998. — Режим доступа: http://www.iskint.ru/?xid=books/sotnik/-part3, свободный. — Загл. с экрана.

3. Методические указания к выполнению лабораторных работ/ Часть 1/ Моделирование искусственных нейронных сетей в системе MATLAB/ Издательство Пензенского государственного университета / Пенза 2005.

4. Национальная Психологическая энциклопедия / Душков Б.А., Королев А.В., Смирнов Б.А. / Энциклопедический словарь: Психология труда, управления, инженерная психология и эргономика, 2005 г. — Режим доступа: http://vocabulary.ru//, свободный. — Загл. с экрана.

- Портал искусственного интеллекта / Проект www.AIportal.ru © 2009-2014 / Режим доступа http://www.aiportal.ru свободный. — Загл. с экрана. — Яз. рус.

Date: 2015-07-17; view: 798; Нарушение авторских прав