Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Определение по Шеннону

Клод Шеннон предположил, что прирост информации равен утраченной неопределённости, и задал требования к её измерению:

1. мера должна быть непрерывной; то есть изменение значения величины вероятности на малую величину должно вызывать малое результирующее изменение функции;

2. в случае, когда все варианты (буквы в приведённом примере) равновероятны, увеличение количества вариантов (букв) должно всегда увеличивать значение функции;

3. должна быть возможность сделать выбор (в нашем примере букв) в два шага, в которых значение функции конечного результата должно являться суммой функций промежуточных результатов.

Поэтому функция энтропии H должна удовлетворять условиям

1.  определена и непрерывна для всех

определена и непрерывна для всех  ,где

,где  для всех

для всех  и

и  . (Нетрудно видеть, что эта функция зависит только от распределения вероятностей, но не от алфавита.)

. (Нетрудно видеть, что эта функция зависит только от распределения вероятностей, но не от алфавита.)

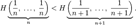

2. Для целых положительных  , должно выполняться следующее неравенство:

, должно выполняться следующее неравенство:

3. Для целых положительных  , где

, где  , должно выполняться равенство

, должно выполняться равенство

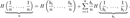

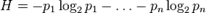

Шеннон показал, что единственная функция, удовлетворяющая этим требованиям, имеет вид

где K — константа (и в действительности нужна только для выбора единиц измерения; например, посредством этой константы можно изменить основание логарифма).

где K — константа (и в действительности нужна только для выбора единиц измерения; например, посредством этой константы можно изменить основание логарифма).

Шеннон определил, что измерение энтропии ( ), применяемое к источнику информации, может определить требования к минимальной пропускной способности канала, требуемой для надёжной передачи информации в виде закодированных двоичных чисел. Для вывода формулы Шеннона необходимо вычислить математическое ожидание «количества информации», содержащегося в цифре из источника информации. Мера энтропии Шеннона выражает неуверенность реализации случайной переменной. Таким образом, энтропия является разницей между информацией, содержащейся в сообщении, и той частью информации, которая точно известна (или хорошо предсказуема) в сообщении.

), применяемое к источнику информации, может определить требования к минимальной пропускной способности канала, требуемой для надёжной передачи информации в виде закодированных двоичных чисел. Для вывода формулы Шеннона необходимо вычислить математическое ожидание «количества информации», содержащегося в цифре из источника информации. Мера энтропии Шеннона выражает неуверенность реализации случайной переменной. Таким образом, энтропия является разницей между информацией, содержащейся в сообщении, и той частью информации, которая точно известна (или хорошо предсказуема) в сообщении.

Определение с помощью собственной информации [править | править вики-текст]

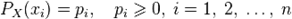

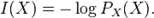

Также можно определить энтропию случайной величины, введя предварительно понятия распределения случайной величины  , имеющей конечное число значений:[2]

, имеющей конечное число значений:[2]

и собственной информации:

и собственной информации:

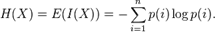

Тогда энтропия определяется как:

От основания логарифма зависит единица измерения количества информации и энтропии: бит, нат, трит или хартли.

Date: 2015-06-11; view: 463; Нарушение авторских прав; Помощь в написании работы --> СЮДА... |