Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Состояния

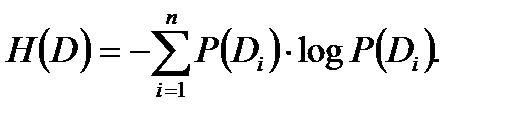

Степень неопределенности состояний рекомендуется характеризовать энтропией, широко используемой в теории информации. При этом если система имеет n случайных состояний D1, D2, D3,…… Dn с вероятностью каждого состояния P(D1), P(D2),…….., P(Dn), и эти состояния несовместимые, то мерой неопределенности оценки состояний может быть энтропия системы

(9.1)

(9.1)

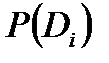

Степень неопределенности системы зависит от числа возможных состояний n и априорных вероятностей  . То есть если система, например, имеет три возможных состояния с вероятностями P(D1) =0,96; P(D2) =0,03; P(D3) =0,01, то с большой достоверностью можно утверждать, что она пребывает в состоянии D1. А если P(D1) =1 и вероятность остальных состояний равна нулю, то система вообще нее обладает неопределенностью и H(D) =0. В случае, когда все априорные вероятности равны, энтропия имеет максимальное значение и соответствует наибольшей неопределенности. В качестве единицы энтропии принята степень неопределенности, равная одному биту.

. То есть если система, например, имеет три возможных состояния с вероятностями P(D1) =0,96; P(D2) =0,03; P(D3) =0,01, то с большой достоверностью можно утверждать, что она пребывает в состоянии D1. А если P(D1) =1 и вероятность остальных состояний равна нулю, то система вообще нее обладает неопределенностью и H(D) =0. В случае, когда все априорные вероятности равны, энтропия имеет максимальное значение и соответствует наибольшей неопределенности. В качестве единицы энтропии принята степень неопределенности, равная одному биту.

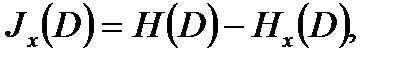

Считают, что само введение энтропии не полностью характеризует неопределенность системы, так как она учитывает только вероятности состояний и их число, но не отражает важность состояний, их близость и др. Поэтому введено понятие «количество информации», которое характеризует степень определенности знаний о состоянии объекта по результатам измерений признаков, получаемых при обследования объекта. За меру количества информации о состоянии, содержащейся в измерении величины, может быть принята разность:

(9.2)

(9.2)

где H(D) –начальная (безусловная) энтропия неопределенности;

Hх(D) – остаточная после измерения параметра х энтропия неопределенности.

Если D и x независимы (параметр х не связан с состоянием D), то

H(D)= Hх(D)

и количество информации, которое несет этот параметр, будет равно нулю. Чем меньше Hх(D), тем больше информации несет измеряемый параметр.

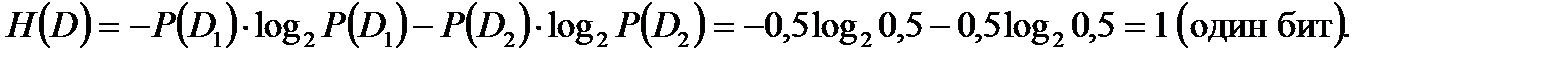

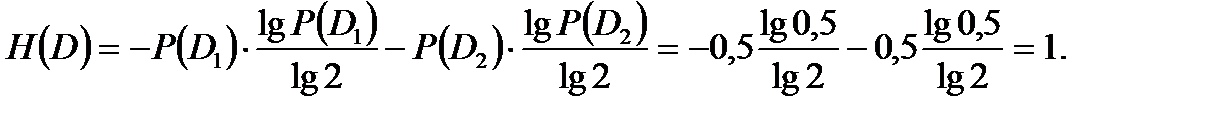

При расчетах рекомендуется использовать вместо десятичных логарифмов (9.1) двоичные логарифмы. Целесообразность такого подхода может быть показана на примере, когда имеет место равенство состояний P(D1) = P(D2) =0,5. Тогда согласно (9.1) можно записать [10]:

Для объяснения получения результата, равного единице, выполним последовательное решение этой зависимости:

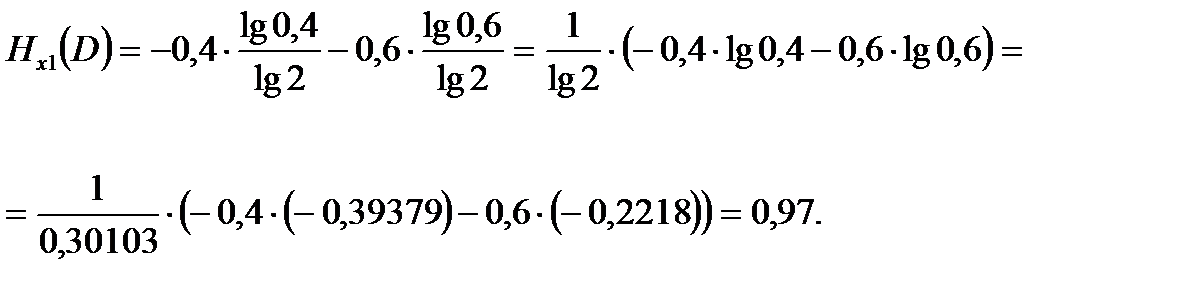

Таким образом, применительно к (9.2) это значение будет соответствовать начальной энтропии. После изменения х1 параметра вероятности установлено, что, например, P(D1) =0,4 и P(D2) =0,6. Тогда величина состояний неопределенности составит:

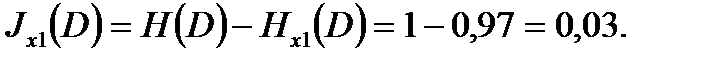

Количество информации о состоянии объекта после измерения параметра х1 составит:

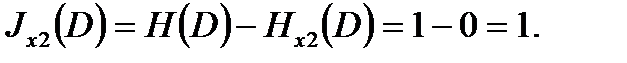

После измерения х1 вероятности состояний P(D1) =1, P(D2) =0, а количество информации

Таким образом, учитывая количество информации о первом и втором параметрах, можно принять за достоверный второй параметр, так как он имеет максимальную информацию, равную единице.

Величина Hх(D) представляет собой остаточную неопределенность в определении состояния системы после измерения параметра х. чем меньше будет ее величина, тем больше информации несет измеряемый параметр, что и видно из приведенного выше расчета.

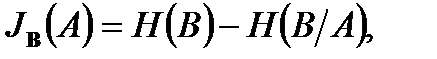

Часто информацию относительно состояния одной системы получают с помощью наблюдения за состоянием другой системы, с ней связанной. Обычно эта вторая система (система сигналов) дает информацию о состоянии основной системы. Среднюю величину этой информации, или интенсивность второй системы, например, В относительно первой, например, А определяют из равенства

где Н(В/А) – условная энтропия системы В относительно системы А.

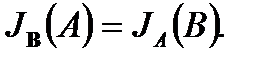

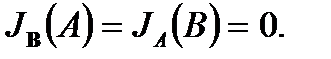

Принято считать, что

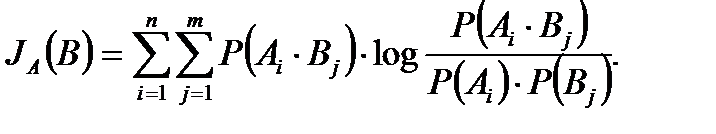

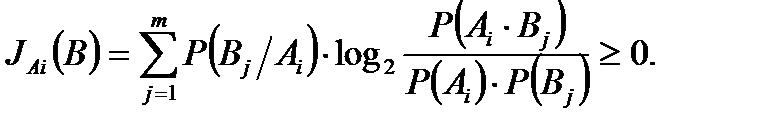

После преобразований формула для определения информации, которую несет система сигналов В относительно системы А, приобретает вид:

(9.3)

(9.3)

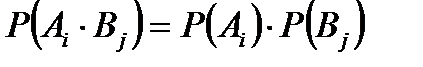

Если системы А и В независимы, то  и тогда из (9.3) следует, что

и тогда из (9.3) следует, что  И это вполне естественно, так как наблюдение над одной системой не может дать информации относительно другой, если между состояниями этих систем нет связи.

И это вполне естественно, так как наблюдение над одной системой не может дать информации относительно другой, если между состояниями этих систем нет связи.

Величина информации относительно состояния системы, полученная в результате контроля конкретного параметра, определяется соотношением:

(9.4)

(9.4)

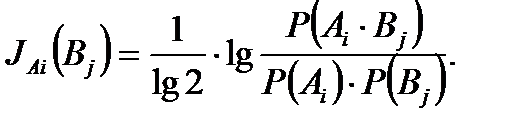

Величину информации, содержащейся в состоянии Bj относительно состояния Ai, определяют по формуле:

(9.5)

(9.5)

На практике получили распространение диагностические признаки (параметры), которые можно разделить на три группы:

- параметры рабочих процессов (динамика изменения давления, усилия, энергии), непосредственно характеризующие техническое состояние оборудования – естественный источник информации;

- параметры сопутствующих процессов или явлений (тепловое поле, шумы, вибрации и др.), косвенно характеризующие техническое состояние;

- параметры структурные (зазоры в сопряжениях, износ деталей и др.), непосредственно характеризующие состояние конструктивных элементов оборудования.

По всем отказам намечаются диагностические параметры, контроль которых поможет оперативно отыскать причину отказа, и метод ТД (табл. 9.1).

Методы технического диагностирования (ТД) Таблица 9.1

| Наименование метода | Определение метода | Объекты ТД | Целевое назначение метода |

| Контроль правильности функционирования | |||

| Функциональных циклограмм | Проверка соответствия положения (переключения) всех электро-, гидро-, пневмоаппаратов схемы функциональной циклограмме, представленной в табличной форме, а также установление порядка срабатывания аппаратов схемы при переходе от одного режима работы к другому | Сложные электро-, гидро-, пневмосхемы технологических линий, комплексов, сложного оборудования | Поиск причин отказов |

| Контроль правильности функционирования | |||

| Фотографирование циклограмм | Определение времени выполнения исполнительными органами рабочих и вспомогательных операций и сопоставление с проверенной при испытаниях расчетной циклограммой | Автоматические линии, автоматизированные комплексы, модули и т. д. | Проверка правильности функционирования |

| Эталонных характеристик | Сравнение значения контролируемого параметра с эталонным значением | Технологические линии, комплексы, сложное оборудование | Проверка правильности функционирования |

| Эталонных зависимостей | Сравнение экспериментально полученной функциональной зависимости в любой момент времени работы с эталонной или расчетной зависимостью | Технологические линии, комплексы, сложное оборудование | Поиск причин отказов, предупреждение отказов |

| Тестов | Определение правильности функционирования с помощью контрольных тестов | Системы программного управления | Проверка правильности функционирования |

| Контроль технического состояния оборудования | |||

| Органолептический | Определение причин отказов и неисправностей оборудования с помощью органов чувств | Механические системы оборудования | Предупреждение отказов |

| Термометрии | Определение технического состояния оборудования с помощью измерения температуры деталей и сборочных единиц | Муфты включения, тормоза, подшипники, электроприводы и другое оборудование | Поиск причин отказов, предупреждение отказов |

| Вибро - акустической диагностики | Определение технического состояния оборудования с помощью измерения параметров вибраций или шума | Приводы, редукторы, трубопроводы гидросистем и т. п. оборудование | Поиск причин отказов, предупреждение отказов |

| Искусственных баз и определения содержания продуктов износа в масле | Определение технического состояния оборудования с помощью измерения износа деталей | Изнашивающиеся детали оборудования | Прогнозирование ресурсов (срока службы) деталей и соединений |

Date: 2015-07-01; view: 345; Нарушение авторских прав; Помощь в написании работы --> СЮДА... |