Полезное:

Как сделать разговор полезным и приятным

Как сделать объемную звезду своими руками

Как сделать то, что делать не хочется?

Как сделать погремушку

Как сделать так чтобы женщины сами знакомились с вами

Как сделать идею коммерческой

Как сделать хорошую растяжку ног?

Как сделать наш разум здоровым?

Как сделать, чтобы люди обманывали меньше

Вопрос 4. Как сделать так, чтобы вас уважали и ценили?

Как сделать лучше себе и другим людям

Как сделать свидание интересным?

Категории:

АрхитектураАстрономияБиологияГеографияГеологияИнформатикаИскусствоИсторияКулинарияКультураМаркетингМатематикаМедицинаМенеджментОхрана трудаПравоПроизводствоПсихологияРелигияСоциологияСпортТехникаФизикаФилософияХимияЭкологияЭкономикаЭлектроника

Основные положения теории информации

Информация – любые сведения в любой форме, первичным источником которых является опыт и наблюдение.

Среди основных положений теории информации основное положение занимает понятие энтропии и количества информации.

Энтропия –мера неопределенности, причем характер неопределенности может быть самым различным: неопределенность исходов предстоящего опыта, ожидаемого сообщения, состояния системы и т.д

Энтропия максимальна при максимальной неопределенности.

Для многих технологических схем производства строительных материалов энтропия выступает как мера возможности технологической переработки.

В случае, если эксперимент может иметь N различных опытов, и благоприятными являются n результатов, то вероятность благоприятного результата будет P = n / N.

Рассмотрение отношения вероятностей приводит к неудобным многоэтажным дробям, поэтому для выражения количества информации, при котором пользуются отношением вероятностей удобно ввести логарифм вероятностей.

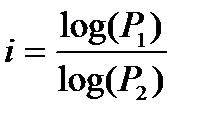

Количество переданной информации выражает отношение выражения логарифма вероятности после получения вероятности к логарифму отношения после получения информации:  .

.

Для количественной оценки неопределенности в теор инф введено пон информац энтропии (H), кот обладает след свойств:

1) значение H должно монотонно возрастать с увеличением числа исходов опыта,

2) значение H равно 0, если имеется единственный исход опыта, т.к. никакой неопределенности не возникает и можно безошибочно определить результат.

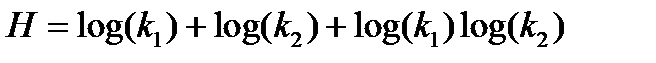

3) ценка неопределенности должна обладать свойством аддитивности в том смысле, что если в результате некоторого сложного опыта имеет место два одновременных исхода k1 и k2, то  ,

,

4) энтропия не может принимать отрицательные значения (нельзя получить меньше информации, чем было до того),

5) энтропия опыта равна 0, когда одна из вероятностей исхода опыта равна 1, а все остальные равны 0.

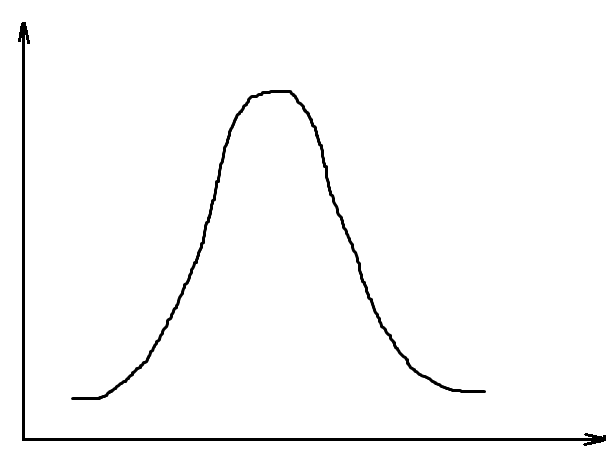

График изменения энтропии для двух исходов опыта

Тот факт, что максимум энтропии отвечает равновероятным событиям хорошо согласуется со смыслом энтропии, т.к. в случае равновероятных событий нельзя отдать предпочтение одному из них.

После проведения опытов неопределенность снимается лишь в простейших случаях полностью. Некоторая неопределенность всегда сохраняется в следствие погрешности приборов, несовершенства методик исследований и отсутствия информации определенных значениях интервала функционирования системы.

Если неопределенность до опытов составляла H1, после опытов H2, то очевидно, что снятая в ходе опыта неопределенность будет составлять I – H1 – H2. Эта разность – количество информации.

При исследовании строительно-технологических систем наиболее оптимальным будет получение информации о функционировании системы сначала в условиях ее реального использования, а затем после создания и использования такой системы, постепенное медленное изменение различных воздействий на систему с получением информации о наиболее перспективных направлениях оптимизации. Для этого можно использовать эволюционное планирование эксперимента с медленным (незначительным) изменением входных воздействий с многократным повторением наблюдений.

Date: 2015-07-17; view: 729; Нарушение авторских прав; Помощь в написании работы --> СЮДА... |